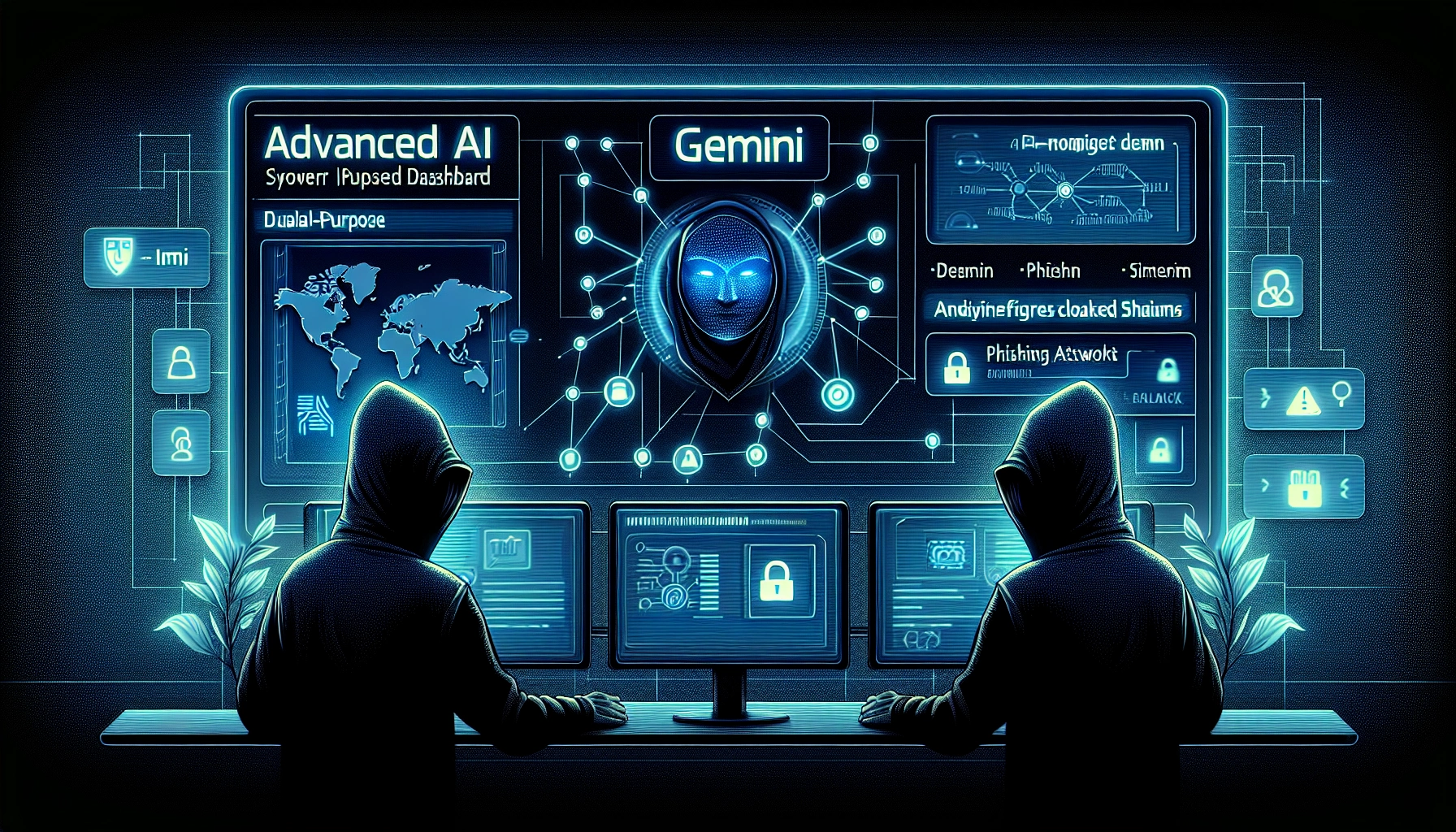

Когда ИИ стал многоруким: как Gemini помог хакерам на всех этапах атаки

От отчёта Google: злоумышленники использовали модель Gemini для рекогносцировки, генерации фишинговых приманок, написания кода и эксфильтрации данных. В публикации разбирают примеры HonestCue, CoinBait и ClickFix, а также попытки извлечения модели.